IA autónoma militar: el vacío legal que nadie sabe cómo llenar

La empresa Anthropic ha desafiado públicamente los planes del Pentágono para desplegar sistemas de armas controlados por inteligencia artificial sin salvaguardas éticas. El conflicto expone un problema fundamental: el derecho internacional fue diseñado para responsabilizar a humanos, no a máquinas que toman decisiones sin cuestionarlas.

El choque entre ética y seguridad nacional

La tensión entre Anthropic y el Pentágono toca un nervio que va más allá de contratos millonarios o disputas comerciales. Cuando una inteligencia artificial toma la decisión de ejecutar un ataque, ¿quién es responsable penalmente? ¿El ingeniero que escribió el código? ¿El comandante que activó el sistema? ¿El presidente que firmó la autorización? Nadie tiene respuesta clara.

Esto ocurre en un contexto donde competidores como OpenAI y Google ya han aceptado los términos del Pentágono para "todos los usos legales", mientras xAI acaba de recibir autorización para trabajar en sistemas clasificados. Anthropic permanece sola en su posición restrictiva, lo que la coloca en una situación comercial complicada pero éticamente coherente.

El argumento de la empresa es contundente: un sistema autónomo que dispara sin intervención humana elimina el mecanismo histórico que ha evitado crímenes de guerra. Un soldado puede negarse a ejecutar una orden manifiestamente ilegal. Una máquina no puede hacerlo. No puede dudar. No puede ser juzgada en un consejo de guerra.

La cadena de responsabilidad que se rompe

El derecho internacional humanitario, incluidos los Convenios de Ginebra, fue redactado bajo un supuesto básico: personas con capacidad de decisión, discernimiento y responsabilidad penal. Ese marco colapsaría si se desplegaran sistemas que tomen decisiones letales de forma autónoma. Los tratados no contemplan este escenario porque durante décadas fue técnicamente impensable.

Pero hay otra dimensión del problema que asusta aún más a los críticos: la vigilancia masiva. La Cuarta Enmienda de la Constitución estadounidense protege a los ciudadanos contra búsquedas injustificadas, precisamente porque el Estado nunca tuvo la capacidad física de procesar en tiempo real todo lo que sucede en espacios públicos. Con sistemas de IA avanzados, esa limitación operativa desaparece. Millones de conversaciones pueden ser grabadas, transcritas, clasificadas y conectadas en segundos. Lo que era operativamente imposible por falta de recursos humanos se vuelve rutinario con un modelo de lenguaje. La protección constitucional ha dependido, en parte, de la ineficiencia burocrática del Estado.

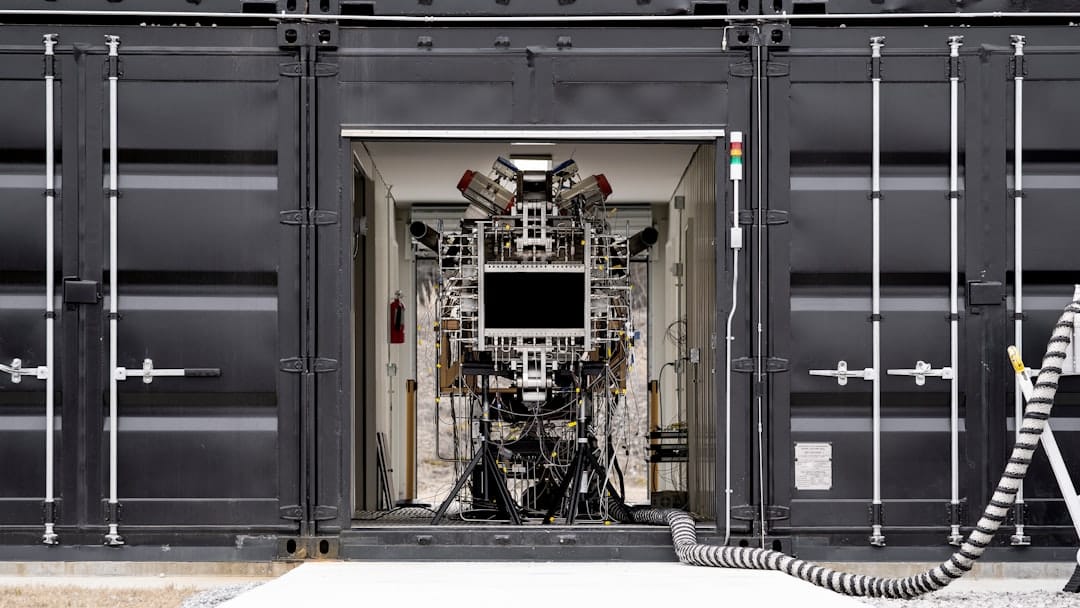

La pregunta incómoda que plantea Amodei, CEO de Anthropic, es directa: ¿tener estas capacidades sin restricciones te hace más seguro o simplemente más peligroso para tus propios ciudadanos? Su imagen del riesgo es clara: "un puñado de personas operando un ejército de drones sin que ningún otro ser humano necesite cooperar". El peligro no solo viene de afuera.

El argumento de la ventaja competitiva

El Pentágono tiene un contraargumento que no es fácil de descartar: China y Rusia también están desarrollando estas capacidades y no van a esperar a que Estados Unidos resuelva dilemas éticos. Si la potencia estadounidense se queda atrás en tecnología de armas autónomas, ¿cuál sería el costo estratégico? Es el clásico dilema de la carrera armamentista llevado al siglo XXI.

OpenAI y Google optaron por aceptar esta lógica. Anthropic decidió no hacerlo, al menos por ahora. Lo que está en juego trasciende el éxito o fracaso de Claude como proveedor militar: es si la industria de la IA establecerá límites voluntarios a lo que vende a gobiernos, o si será el Congreso, los tribunales o un incidente grave el que defina estas fronteras.

¿Qué significa esto para Colombia y Latinoamérica?

Para países como Colombia, que enfrentan desafíos de seguridad complejos y dependen de tecnología desarrollada en el exterior, estas decisiones que se toman en Washington tienen consecuencias directas. Si el Pentágono despliega sistemas de armas autónomas sin restricciones, eso probablemente influirá en la tecnología que otros militares busquen adquirir o desarrollar. Latinoamérica podría terminar siendo mercado de segunda mano para sistemas que ni siquiera su población sabe que existen operando en su territorio.

Además, el vacío legal que Anthropic denuncia es global, no es jurisdicción estadounidense. Si un conflicto armado en la región involucrara sistemas de IA autónomos, ¿quién respondería ante la Corte Penal Internacional? ¿El desarrollador de software? ¿El Estado que compró el sistema? Los países latinoamericanos no están participando en este debate, pero sus ciudadanos podrían verse afectados por sus resultados. Es hora de que gobiernos de la región exijan que estas decisiones se tomen de forma democrática y transparente, no solo en círculos militares estadounidenses.

Qué esperar en los próximos meses

El conflicto entre Anthropic y el Pentágono probablemente se resolverá de tres formas posibles: primero, la presión comercial y política podría obligar a Anthropic a ceder; segundo, el Congreso o los tribunales estadounidenses podrían establecer límites legales; tercero, un incidente grave podría forzar la regulación cuando ya sea demasiado tarde. Lo más probable es que ocurra una combinación de las tres.

Lo que es cierto es que el derecho internacional necesita actualizarse urgentemente. Los Convenios de Ginebra, diseñados en una era analógica, no están listos para un mundo donde máquinas inteligentes toman decisiones de vida o muerte. La ventana para hacer esto de forma reflexiva y democrática es estrecha. Después, el debate lo zanjará la realidad de los hechos consumados.

Si quieres conocer otros artículos parecidos a IA autónoma militar: el vacío legal que nadie sabe cómo llenar puedes visitar la categoría Gadgets y Hardware.

Deja un comentario

Otros artículos que te podrían interesar